- Czym jest web scraping? Definicja i podstawy

- Do czego służy web scraping? Zastosowania biznesowe w 2026

- Najlepsze narzędzia do web scrapingu w 2026

- Jak zacząć scrapować? Praktyczny tutorial w Pythonie

- Czy web scraping jest legalny w Polsce? RODO i prawo

- Przykłady firm, które zarabiają na web scrapingu

- Przyszłość web scrapingu: trendy 2026-2030

- FAQ — Najczęściej zadawane pytania

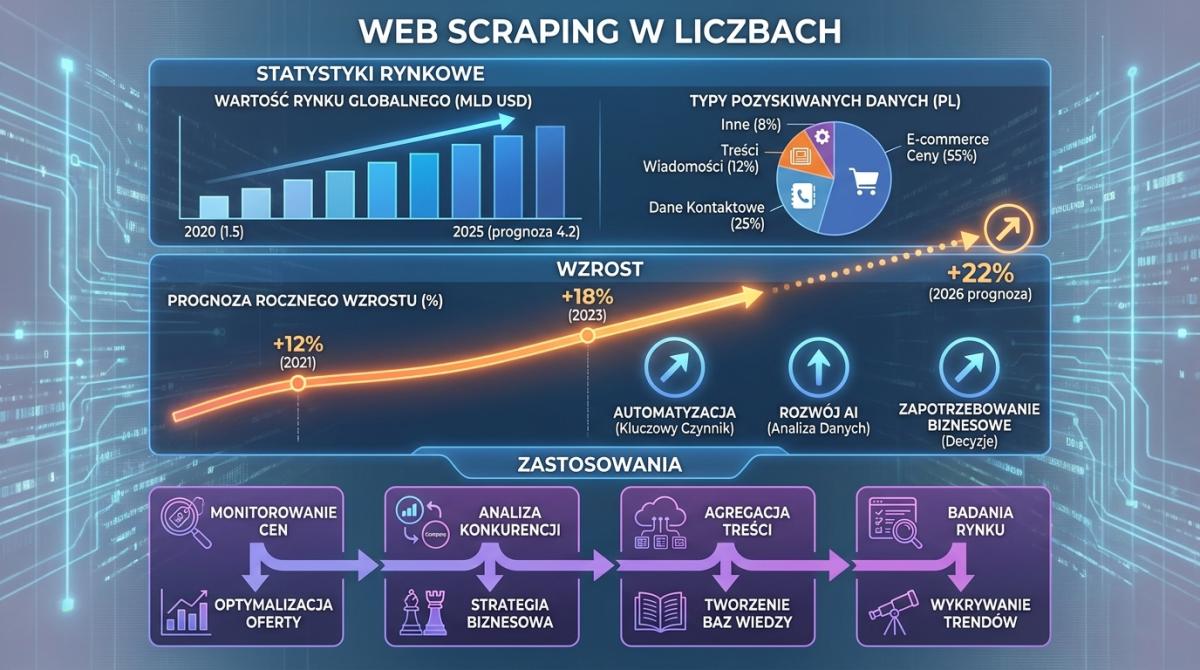

Rynek web scrapingu przekroczył 1 miliard dolarów i ma osiągnąć 2 miliardy do 2030 roku (Grand View Research). Wzrost o 13-18% rocznie. A tymczasem większość polskich firm nadal zbiera dane o konkurencji ręcznie. Kopiuj-wklej, kopiuj-wklej, kopiuj-wklej. Serio, w 2026 roku?

Zastanów się — skąd czerpiesz dane o rynku, cenach konkurencji, potencjalnych klientach? Jeśli odpowiedź brzmi "ręcznie z Google'a" albo "kupuję bazy danych sprzed pół roku" — ten przewodnik jest dla Ciebie. I to nie jest kolejny suchy artykuł techniczny. Pokażę Ci konkretne narzędzia, prawdziwe przykłady firm i realny kod, który możesz odpalić w 5 minut.

Weźmy Tomka. Tomek prowadzi agencję marketingową w Krakowie. Ma 15 klientów i każdemu obiecał "dane rynkowe" na potrzeby strategii. Efekt? Jego zespół marnuje 20 godzin tygodniowo na wyszukiwanie firm, emaili, telefonów. Jakby ktoś ręcznie przepisywał książkę telefoniczną. W XXI wieku. A co gdyby zamiast tego mógł wyciągnąć te same dane automatycznie, w kilka minut? No właśnie.

Czym jest web scraping? Definicja i podstawy

Web scraping (scrapowanie stron) to zautomatyzowana technika pobierania danych ze stron internetowych za pomocą botów lub skryptów. Polega na ekstrakcji informacji z kodu HTML strony i zapisaniu ich w ustrukturyzowanym formacie (CSV, baza danych). Rynek web scrapingu jest wyceniany na ponad 1 miliard dolarów i rośnie w tempie kilkunastu procent rocznie.

Brzmi skomplikowanie? Wcale nie. Kiedy ręcznie kopiujesz ceny z jakiejś strony do Excela — robisz scraping danych. Tyle że rękami i bardzo, bardzo wolno. Pobieranie danych ze strony internetowej w ten sposób działa, jasne — ale skrypt zrobi to samo w ułamku sekundy. I nie popełni literówki przy okazji.

Web scraping vs web crawling — jaka jest różnica?

Ludzie nagminnie mylą te dwa pojęcia. Web crawling to "łażenie" po sieci — przeskakiwanie z jednego linka na drugi, dokładnie tak jak robi to Google Bot, kiedy indeksuje internet. Natomiast scraping to coś innego: wyciąganie konkretnych informacji z tych stron. Ceny, emaile, numery telefonów, opinie klientów.

Podsumowując: crawling odkrywa strony, scraping wyciąga z nich dane. Często działają razem, ale to nie to samo.

Jak działa scrapowanie stron internetowych?

Cały proces — niezależnie czy używasz Pythona, Octoparse'a czy jakiegokolwiek innego narzędzia — sprowadza się do czterech kroków:

- Fetching (pobieranie) — skrypt wysyła zapytanie HTTP do strony, dokładnie jak Twoja przeglądarka

- Parsing (analiza) — przegląda kod HTML, szuka interesujących elementów

- Extraction (ekstrakcja) — wyciąga dane — ceny, adresy, telefony, cokolwiek potrzebujesz

- Storage (zapis) — pakuje wszystko do CSV, JSONa albo bazy danych

[INFOGRAFIKA: Proces web scrapingu — fetching → parsing → extraction → storage]

Cztery kroki. Proste? Bardzo. A teraz zobaczmy, po co właściwie warto to robić.

Do czego służy web scraping? Zastosowania biznesowe w 2026

Scrapowanie danych to nie jest zabawka dla programistów, którzy chcą się popisać skryptami. To narzędzie, które generuje realne pieniądze — i to w bardzo różnych branżach.

E-commerce: monitoring cen i compliance MAP

Dane Prisync z 2024 roku mówią jasno: 81% detalistów w USA korzysta z automatycznego monitoringu cen. Bo ręczne sprawdzanie cen konkurencji na 50 sklepach dziennie? To nie praca — to kara. Scrapowanie danych robi to automatycznie i na bieżąco. Masz sklep internetowy? Wiesz natychmiast, kiedy konkurent obniża cenę o 15%. Reagujesz tego samego dnia, a nie za tydzień.

Generowanie leadów i prospecting B2B

Prawdopodobnie najpopularniejsze zastosowanie biznesowe w Polsce — i w ogóle jedno z najczęstszych na świecie. Zamiast ręcznie szukać firm w Google i przeklikiwać się przez dziesiątki stron, odpalam skrypt (albo klikam dwa przyciski w narzędziu no-code) i mam tysiące kontaktów w pliku CSV.

Analiza konkurencji i market intelligence

Chcesz wiedzieć, jakie technologie ma na stronie Twoja konkurencja? Jakie zbiera opinie na Google Maps? Ile zdjęć wrzuciła? Ekstrakcja danych ze stron www Ci to powie. Nie raz — w sposób ciągły i automatyczny. Możesz śledzić zmiany tydzień po tygodniu.

AI i ML: dane treningowe

Tu jest ciekawie. Według raportu Deloitte z 2024 roku, 65% przedsiębiorstw korzysta ze scrapowania do pozyskiwania danych treningowych dla sztucznej inteligencji. Modele AI potrzebują danych jak samochód paliwa — bez odpowiedniego zasilania danymi nie ruszą z miejsca. A ręczne zbieranie tych danych w dużej skali? Nierealne.

SEO i marketing cyfrowy

Automatyczne zbieranie danych z internetu pozwala śledzić pozycje w wynikach wyszukiwania, analizować słowa kluczowe u konkurencji, monitorować backlinki. Narzędzia takie jak Ahrefs czy SEMrush? Są zbudowane dokładnie na tej zasadzie — pod spodem to zaawansowane scrapowanie na ogromną skalę.

Nieruchomości i finanse

Agregowanie ofert nieruchomości z kilkudziesięciu portali jednocześnie? Scraping. Śledzenie kursów walut i cen akcji w czasie rzeczywistym? Też scraping. A szerzej patrząc na polski rynek cyfrowy — z wartością e-commerce przekraczającą 20 miliardów dolarów — potencjał dla automatyzacji zbierania danych jest naprawdę spory.

Najlepsze narzędzia do web scrapingu w 2026

Dobra, przejdźmy do konkretów. Jakich narzędzi użyć? To zależy — od Twoich umiejętności, budżetu i tego, co właściwie chcesz scrapować.

Biblioteki Python (dla programistów)

Polska ma ponad 300 000 programistów (Stack Overflow, 2024) — głównie w Warszawie, Krakowie, Wrocławiu, Gdańsku i Poznaniu. Jeśli umiesz kodować choćby trochę, te biblioteki będą Twoim naturalnym wyborem:

BeautifulSoup + Requests — absolutne podstawy. Jeśli chcesz się nauczyć web scraping Python BeautifulSoup, to jest punkt wyjścia. Czytelna składnia, mnóstwo tutoriali w internecie, wystarczająca moc na większość prostych projektów.

Scrapy — profesjonalny framework do ekstrakcji danych na dużą skalę. Kolejki, proxy, rate limiting — cała infrastruktura gotowa. Krzywa nauki jest stroma, ale jak się raz nauczysz, to ciężka artyleria.

Selenium / Playwright — niezbędne kiedy strona ładuje dane przez JavaScript. Selenium symuluje prawdziwą przeglądarkę, więc widzi dokładnie to, co widzi użytkownik. Web scraping Python Selenium to właściwie standard przy nowoczesnych stronach SPA i aplikacjach React.

Narzędzia no-code (bez programowania)

Nie umiesz programować? Nie ma problemu. Scrapowanie bez kodowania jest jak najbardziej możliwe — i szczerze mówiąc, dla większości zastosowań biznesowych to wystarczy.

Octoparse — wizualny interfejs, klikasz elementy które chcesz zebrać, reszta dzieje się automatycznie. Niski próg wejścia.

Apify — platforma cloud z gotowymi scraperami. Liczby mówią same za siebie: ponad 13 000 aktywnych scraperów i 142% wzrost aktywnych użytkowników miesięcznie. Ekosystem rośnie jak szalony.

Scrap.io — specjalizacja w narzędziach no-code do scrapowania danych z Google Maps. 200 milionów firm zaindeksowanych, 195 krajów, ponad 4 000 kategorii biznesowych. Najlepsza część? Filtrujesz przed eksportem — płacisz tylko za kontakty, które faktycznie spełniają Twoje kryteria.

Rozszerzenia Chrome do web scrapingu

Czasem nie potrzebujesz kombajnu — wystarczy coś lekkiego. Popularny web scraper Chrome to rozszerzenia Chrome do web scrapingu jak Web Scraper albo Data Miner. Instalujesz, klikasz, scrapujesz. Bez żadnej konfiguracji. Jeśli szukasz czegoś na początek, na testy, na web scraping dla początkujących — to dobry punkt startu, zanim zdecydujesz się na coś poważniejszego.

API do scrapowania

Web scraping API — to opcja dla tych, którzy chcą wprost zintegrować ekstrakcję danych z własnym systemem, CRM-em czy automatyzacją. Google Maps API daje oficjalny dostęp do danych, ale jest drogi. Każde zapytanie kosztuje. Alternatywy jak ScraperAPI albo API Scrap.io (300 zapytań na minutę, format JSON) oferują znacznie lepszy stosunek jakości do ceny.

Żeby było prościej, zebrałem to w jednym miejscu:

| Narzędzie | Typ | Cena | Trudność | Najlepsze do... |

|---|---|---|---|---|

| BeautifulSoup | Python | Darmowe | Średnia | Proste strony statyczne |

| Scrapy | Python | Darmowe | Wysoka | Duże projekty scrapingu |

| Selenium | Python | Darmowe | Średnia | Strony dynamiczne (JS) |

| Octoparse | No-code | Od $89/mies. | Niska | Wizualne scrapowanie |

| Apify | Cloud | Od $49/mies. | Niska | Gotowe scrapery |

| Scrap.io | No-code | Od 49€/mies. | Bardzo niska | Google Maps, leady B2B |

Jak zacząć scrapować? Praktyczny tutorial w Pythonie

Jak scrapować stronę internetową w praktyce? Zróbmy to szybko — trzy kroki i masz działający scraper.

Krok 1: Instalacja

Otwierasz terminal, wpisujesz jedną komendę:

pip install requests beautifulsoup4To wszystko. Dwie biblioteki, zero komplikacji.

Krok 2: Prosty skrypt — skopiuj i odpal

import requests

from bs4 import BeautifulSoup

import csv

# Krok 1: Pobierz stronę

url = "https://quotes.toscrape.com/"

odpowiedz = requests.get(url)

# Krok 2: Parsuj HTML

soup = BeautifulSoup(odpowiedz.text, "html.parser")

# Krok 3: Znajdź cytaty

cytaty = soup.find_all("div", class_="quote")

# Krok 4: Zapisz do CSV

with open("cytaty.csv", "w", newline="", encoding="utf-8") as plik:

writer = csv.writer(plik)

writer.writerow(["Cytat", "Autor"])

for cytat in cytaty:

tekst = cytat.find("span", class_="text").get_text()

autor = cytat.find("small", class_="author").get_text()

writer.writerow([tekst, autor])

print(f"Zapisano {len(cytaty)} cytatów do pliku CSV!")Krok 3: Co właściwie robi ten skrypt?

W sumie nic skomplikowanego:

- Wysyła zapytanie HTTP do strony (

requests.get) — tak jak Twoja przeglądarka - Parsuje kod HTML za pomocą BeautifulSoup — szuka elementów o klasie "quote"

- Wyciąga tekst cytatu i nazwisko autora z każdego elementu

- Zapisuje wynik do pliku CSV

Odpalasz, czekasz sekundę i masz plik z danymi. Dziesięć linijek kodu. Twój pierwszy scraper.

Warto wiedzieć, że jeśli strona ładuje treść przez JavaScript (a coraz więcej stron tak robi), BeautifulSoup nie wystarczy. Potrzebujesz wtedy web scraping Python Selenium albo Playwright, które symulują prawdziwą przeglądarkę i "widzą" to samo, co użytkownik.

A jeśli nie chcesz pisać ani jednej linijki kodu? Darmowe narzędzia do scrapowania jak Scrap.io pozwalają osiągnąć ten sam rezultat w przeglądarce. Wybierasz kategorię, lokalizację, klikasz eksportuj. Koniec.

Czy web scraping jest legalny w Polsce? RODO i prawo

Najważniejsze pytanie — i bardzo dobrze, że je zadajesz. Web scraping legalność polska — rozkładam to na czynniki pierwsze.

Zasada ogólna

Web scraping jest co do zasady legalny, pod warunkiem przestrzegania: (1) prawa RODO przy danych osobowych, (2) warunków regulaminów stron, (3) pliku robots.txt, (4) zasady proporcjonalności.

Scrapowanie stron internetowych w celu zbierania danych publicznych — jest dozwolone. Jednak kiedy wchodzą w grę dane osobowe, sprawa się komplikuje. I to nie jest kwestia abstrakcyjna — UODO potrafi nałożyć realną karę. Więcej o legalności scrapowania danych z Google Maps pisaliśmy w osobnym artykule.

RODO/GDPR — nie lekceważ tego

RODO dotyczy każdego, kto przetwarza dane osobowe obywateli UE. Niezależnie czy siedzisz w Warszawie, Berlinie czy San Francisco. Jeśli scrapujesz cokolwiek, co zawiera dane osobowe — web scraping RODO to temat, który musisz ogarnąć. Cztery kluczowe zasady:

- Minimalizacja danych — zbieraj wyłącznie to, czego faktycznie potrzebujesz, nie "na zapas"

- Cel przetwarzania — musisz umieć uzasadnić, po co te dane zbierasz

- Dokumentacja — prowadź rejestr: co scrapujesz, skąd, dlaczego i co z tym robisz

- Prawo do usunięcia — ktoś żąda usunięcia swoich danych? Musisz to zrobić

Precedensy prawne — cztery wyroki, które warto znać

hiQ vs LinkedIn (USA, 2022) — Sąd orzekł, że scrapowanie publicznie dostępnych danych jest legalne. LinkedIn nie może blokować dostępu do profili, które sam wystawił na widok publiczny. Ten wyrok odbiło się echem na całym świecie i wiele europejskich kancelarii odwołuje się do niego w opiniach.

Clearview AI — Kara 20 milionów euro we Włoszech i 30,5 miliona euro w Holandii. Masowe scrapowanie zdjęć twarzy z mediów społecznościowych, bez zgody, do rozpoznawania twarzy. To skrajny przypadek — mowa o danych biometrycznych, nie o publicznych numerach telefonów firm.

KASPR (CNIL, Francja, 2024) — 240 000 euro kary za scrapowanie danych z LinkedIn do celów komercyjnych. Firma nie miała odpowiedniej podstawy prawnej do przetwarzania tych danych. Ważny precedens dla wszystkich, którzy scrapują portale społecznościowe.

UODO Polska (2019) — 220 000 PLN kary. Za co? Scrapowanie danych z publicznych rejestrów i wykorzystywanie ich bez informowania osób, których dane dotyczyły. Klucz: nie tyle sam scraping był problemem, co brak transparentności wobec osób fizycznych.

Praktyczna rada

Scrapuj dane, które firmy same udostępniły publicznie — i informuj o przetwarzaniu. Dlatego platformy jak Scrap.io, które zbierają wyłącznie informacje widoczne na Google Maps i stronach firmowych, działają na bezpiecznym gruncie. Firma sama wstawiła email i telefon do swojej wizytówki — to dane publiczne, dostępne dla każdego kto wpisze ją w Google.

Przykłady firm, które zarabiają na web scrapingu

Dość teorii i definicji. Czas na realne przykłady — firmy, które zarabiają na scrapowaniu konkretne pieniądze.

GroupBWT (Ukraina/USA) zbudowali system scrapingu e-commerce do prognozowania popytu. Efekt? 85% wzrost dokładności prognoz sprzedaży i 30% mniej nadmiernych zapasów. Mniej pieniędzy zamrożonych na magazynie, lepsze decyzje zakupowe. Prosty kalkulator pokaże, ile to daje oszczędności na koniec roku.

3i Data Scraping (Indie/globalnie) — zautomatyzowali ekstrakcję danych produktowych i cenowych z marketplace'ów e-commerce. Rezultat: 15% wzrost przychodu u klientów dzięki monitoringowi cen plus 40% redukcja kosztów manualnego zbierania danych. Czterdzieści procent. Warto to powtórzyć, bo ta liczba nie jest błędem.

ProWebScraper — scrapowanie danych nieruchomości do agregowania ofert w czasie rzeczywistym. 67% wzrost przychodu. Na polskim rynku, gdzie portale z ogłoszeniami rosną jak grzyby po deszczu, aktualność danych to przewaga, za którą klienci płacą premium.

Apify — platforma cloud, która odnotowała 142% wzrost aktywnych użytkowników i ma ponad 13 000 scraperów w swoim marketplace. Dowód na to, że rynek narzędzi no-code eksploduje.

Grepsr (Nepal/USA) — zbieranie danych na ogromną skalę dla firm badających rynki. Klienci raportują 10-krotny zwrot z inwestycji w projekty market intelligence. Dziesięciokrotny ROI. Ile inwestycji daje Ci taki zwrot?

Przyszłość web scrapingu: trendy 2026-2030

Rynek rośnie z 1,03 miliarda dolarów do prognozowanych 2 miliardów do 2030 (Grand View Research). CAGR 13-18% — i to nie jest jedyny sygnał. Rynek proxy rezydencjalnego, bezpośrednio powiązany ze scrapowaniem, jest wart już 26 miliardów dolarów (Verified Market Research, 2024). Infrastruktura pod scraping rośnie szybciej niż sam scraping.

Co się zmienia?

AI-powered scraping — scrapery napędzane sztuczną inteligencją, które same adaptują się do zmian na stronach. Zmienił się layout? Scraper się dostosuje. Koniec z ręcznym poprawianiem selektorów CSS po każdej aktualizacji strony. Przyszłość web scrapingu i AI to kierunek, który warto obserwować.

Cloud i serverless — nie musisz utrzymywać własnego serwera. Odpalisz scrapera w chmurze, zapłacisz za użycie, zeskalijesz kiedy trzeba. Apify i Scrap.io już tak działają.

No-code jako nowy standard — programiści zawsze będą używać Pythona i Scrapy do zaawansowanych rzeczy. Ale dla 90% zastosowań biznesowych narzędzia wizualne wystarczą. AI scraper — przewodnik po narzędziach no-code pokazuje dokładnie, co już teraz jest możliwe bez pisania kodu.

Scraping danych z Google Maps — ekstrakcja danych z map i lokalnych wyników wyszukiwania staje się jednym z najszybciej rosnących segmentów. Nie dlatego że to modne — dlatego że Google Maps to największa baza firm na świecie i każdy lead stamtąd jest z natury "lokalny" i aktualny.

FAQ — Najczęściej zadawane pytania

Co to jest web scraping?

Web scraping (scrapowanie stron) to zautomatyzowana technika pobierania danych ze stron internetowych za pomocą botów lub skryptów. Polega na ekstrakcji informacji z kodu HTML — ceny, adresy, emaile, opinie — i zapisaniu ich w ustrukturyzowanym formacie jak CSV lub baza danych.

Czy web scraping jest legalny w Polsce?

Tak, co do zasady jest legalny. Scrapowanie publicznie dostępnych danych jest dozwolone. Trzeba jednak przestrzegać RODO przy danych osobowych, respektować regulaminy stron i plik robots.txt. UODO w 2019 roku nałożyło karę 220 000 PLN za scraping publicznych rejestrów bez informowania osób — więc transparentność jest kluczowa.

Jakie narzędzia do web scrapingu są najlepsze dla początkujących?

Programujesz w Pythonie? Zacznij od BeautifulSoup — prosty, dobrze udokumentowany, ogrom tutoriali. Nie kodujesz? Octoparse albo Apify mają wizualne interfejsy. A jeśli potrzebujesz konkretnie kontaktów firm z Google Maps — Scrap.io pozwala scrapować bez kodowania w dosłownie dwa kliknięcia.

Czy potrzebuję umiejętności programowania, żeby scrapować?

Nie. Narzędzia no-code jak Octoparse, Apify czy Scrap.io pozwalają scrapować strony bez napisania ani linijki kodu. Python daje większą elastyczność przy złożonych projektach, ale dla typowych potrzeb biznesowych — generowania leadów, monitoringu cen, pobierania danych kontaktowych — narzędzia wizualne w zupełności wystarczą.

Jak web scraping może pomóc mojej firmie?

Najczęstsze zastosowania: monitoring cen konkurencji (e-commerce), automatyczne generowanie leadów B2B (agencje, software house'y), analiza konkurencji, oraz pozyskiwanie danych dla modeli AI/ML. Według Deloitte, 65% przedsiębiorstw już korzysta ze scrapowania w kontekście sztucznej inteligencji.

Podsumowanie

Scrapowanie danych w 2026 to nie opcja do rozważenia kiedyś tam — to konieczność biznesowa. Rynek rośnie 13-18% rocznie, 81% detalistów monitoruje ceny automatycznie, 65% firm zasila scrapingiem swoje modele AI. Nieważne czy jesteś programistą z Krakowa budującym zaawansowane scrapery w Pythonie, czy właścicielem firmy z Warszawy szukającym prostego sposobu na zdobycie kontaktów do nowych klientów — narzędzia istnieją i czekają.

Pamiętaj tylko — Twoja konkurencja prawdopodobnie już to robi. Pytanie nie brzmi "czy warto", tylko kiedy sam zaczniesz.